AI可以复刻员工的基础工作能力,却复刻不了人类的情感共鸣、随机应变,更复刻不了一个人的人格尊严。

图片内容来源于网络

彩云网评特约评论员 丁铁

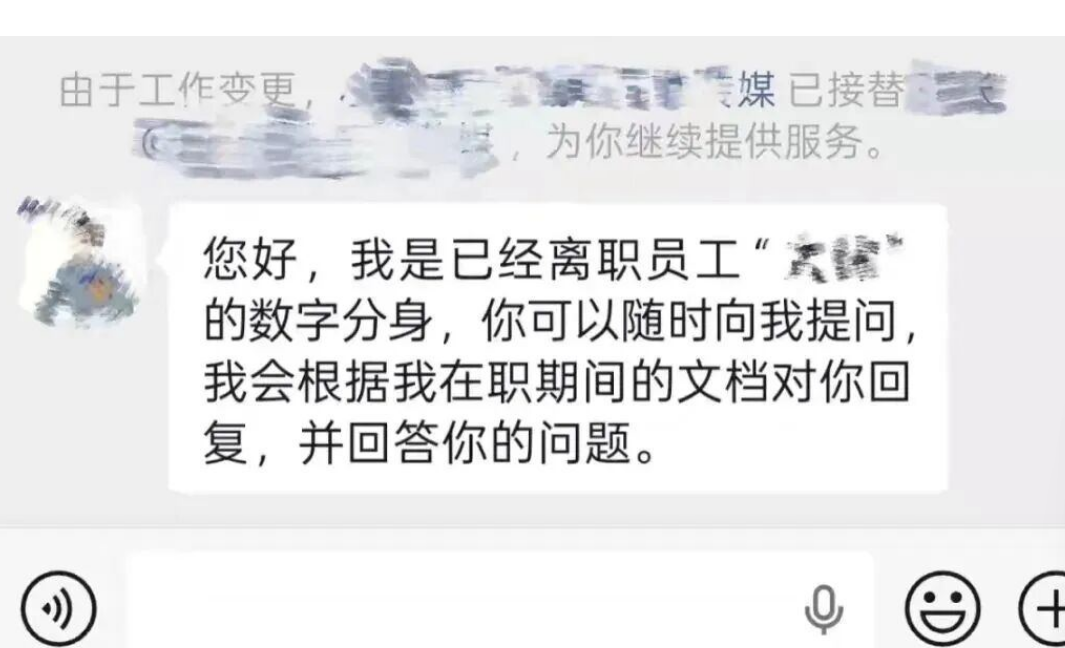

近日,山东一游戏传媒公司尝试将离职的人事专员训练成AI数字人继续工作,可处理咨询、邀约等简易事务。经媒体报道后,相关话题冲上热搜,引发网友广泛热议。有人觉得新奇好玩,也有人质疑此举逾越了法治与伦理边界。

据该公司员工称,事件中的当事人确已离职,本次尝试经过其本人同意,他也觉得挺有意思。表面上看,这是一场你情我愿的技术尝试,但在人工智能技术日新月异的当下,社会与公众的思考绝不能只停留在“好玩”的猎奇层面。在调侃“赛博永生”之余,我们既要看到职场人自身价值被拆解、被物化的风险,更应思考:今天是离职同事被“炼化”成AI,明天会不会是在职员工被悄悄复刻?

毋庸置疑,技术迭代的速度已远超想象,随之而来的除了触手可及的便捷高效,或许还有难以预见、难以有效应对的风险。企业尝试用AI复刻离职员工,初衷或许是沉淀工作经验、降低交接成本。但是,这类解决“人走知识断档”的技术应用,是否已经模糊了权利边界、忽视了伦理底线?根据《个人信息保护法》规定,离职员工的聊天记录、工作邮件、个人工作习惯等均属于个人信息。即便系工作期间产生的数据,也不意味着企业可以随意使用。

针对此次事件,有律师提醒,未经员工同意收集、使用其数据训练AI,直接侵犯其个人信息权益;情节特别严重的,还可能涉嫌侵犯公民个人信息罪,最高可判处七年有期徒刑。即便获得当事人同意,这份“同意”也应是明确、自愿、有偿且权责清晰的,而非模糊不清的口头承诺,更不能是劳资关系不对等下的被动妥协。显然,即便员工已经离职,企业即便迫切需要复刻其“数字分身”继续提供服务,也绝不能突破法律红线。

同时需要清醒认识到,AI复刻离职员工不仅涉及法律问题,还潜藏着科技伦理风险。技术本身无善恶,但运用技术的人必须守住底线。AI可以复刻员工的基础工作能力,却无法复刻人类的情感共鸣与随机应变,更无法复刻一个人的人格尊严。将离职员工拆解为可重复调用的“功能模块”,本质上是对劳动者的轻视,长此以往会破坏职场信任,让在职员工陷入“随时可能被替代”的焦虑。如果技术被滥用,意识层面的恐慌乃至现实层面的威胁或将迅速显现。

就在人们热议AI复刻离职员工之际,为规范人工智能科技活动伦理治理、推动人工智能产业健康发展,工业和信息化部等十部门近日印发《人工智能科技伦理审查与服务办法(试行)》,明确要求强化隐私保护、实现责任可追溯。制度规定是一方面,更重要的是落地执行。当下,尤其需要对AI复刻员工这类新型应用加强监管,推动行业主动自律,严守AI使用的伦理规范,让AI真正成为助力工作的工具,而非侵蚀人权的载体。

AI复刻离职员工的技术尝试,也是对权利边界、伦理底线的一次考验。技术可以创新,但不能越界;法律与伦理的底线必须坚决守住。确保技术始终服务于人,才是我们从这一事件中最应汲取并践行的启示。

彩云网评所登载的所有文章仅代表作者个人观点,与本网站立场无关。欢迎关注彩云网评,投稿邮箱yncywp@163.com,稿费从优。